Table des matières :

Gemini 2.5 Pro : L'intelligence ultime signée Google

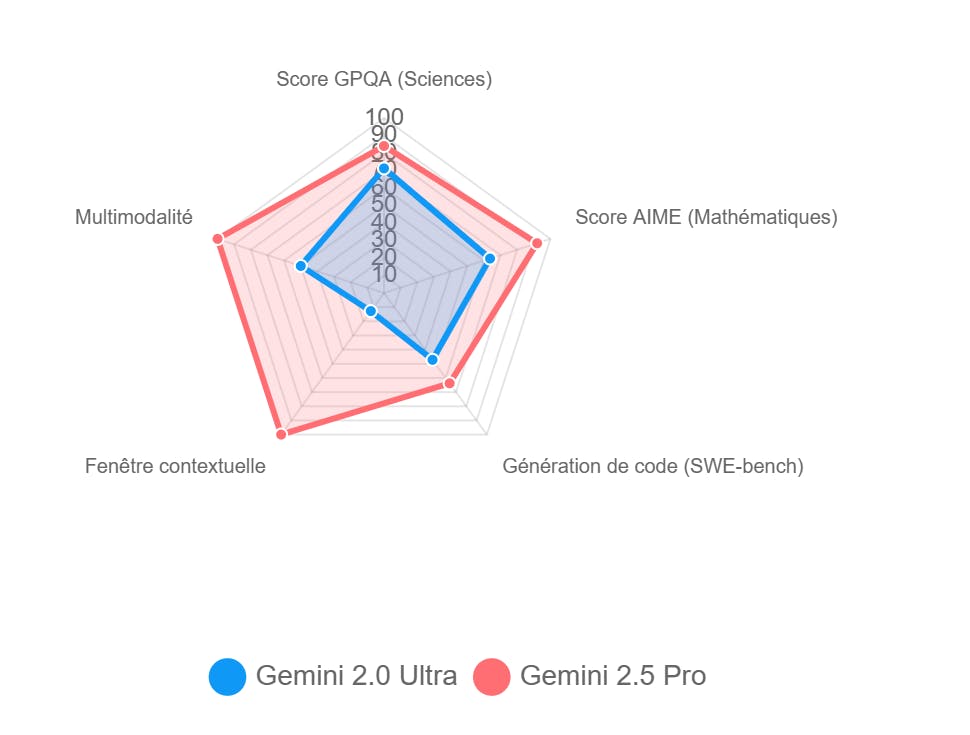

Il est temps d'optimiser vos projets d'intelligence artificielle ! Avec ses capacités de raisonnement comparables à celles d'un expert humain, Gemini 2.5 Pro redéfinit les standards de l'IA générative en 2025. Plus de 84% des problèmes scientifiques complexes du benchmark GPQA sont désormais résolus correctement par ce modèle, contre seulement 71% pour GPT-4.5, marquant un tournant décisif dans la course à l'intelligence artificielle avancée.

Prêt à transformer votre entreprise avec l'IA ?

Découvrez comment l'IA peut transformer votre entreprise et améliorer votre productivité.

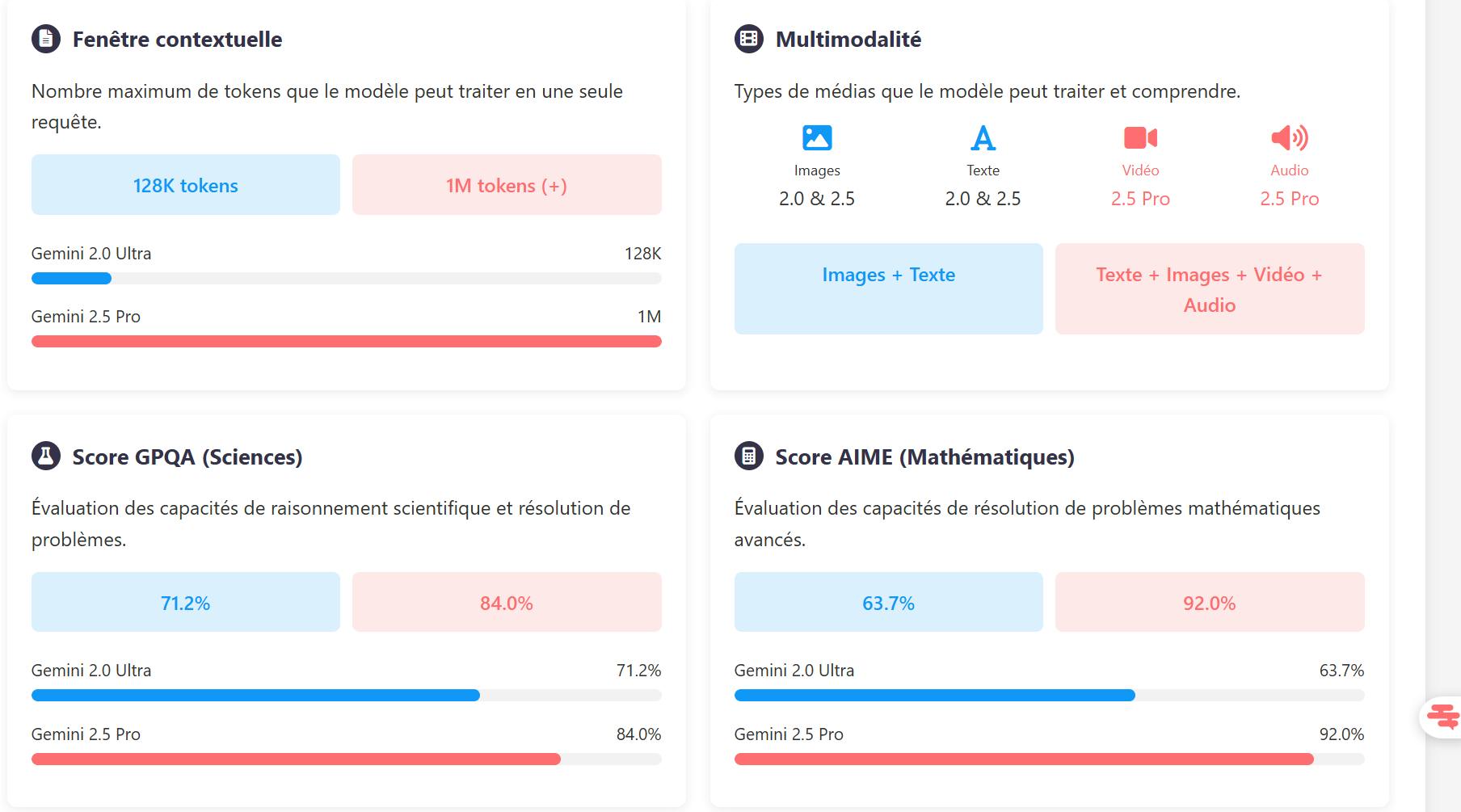

Face à l'explosion des données non structurées dans les entreprises - estimées à 80% de l'information disponible selon IDC - la capacité de Gemini 2.5 Pro à traiter simultanément texte, code, images et vidéos dans un contexte unifié de 1 million de tokens représente une avancée majeure. Cette multimodalité native permet enfin d'exploiter pleinement la richesse informationnelle des documents techniques, présentations visuelles et bases de code sans les fragmenter.

Nous explorerons en profondeur les capacités révolutionnaires de Gemini 2.5 Pro, ses applications concrètes pour les développeurs et les entreprises, ainsi que sa position face aux modèles concurrents. Vous découvrirez comment ce modèle de Google DeepMind transforme radicalement l'analyse de données complexes, le développement logiciel et l'automatisation des processus métiers grâce à son architecture de "thinking model" unique. C'est parti !

Gemini 2.5 Pro : architecture révolutionnaire

Qu'est-ce qui différencie Gemini 2.5 Pro des autres modèles d'IA ?

Lancé fin mars 2025, Gemini 2.5 Pro représente une évolution majeure dans l'approche même du traitement de l'information par les modèles d'IA. Contrairement aux architectures traditionnelles qui privilégient la prédiction directe, ce modèle intègre une phase de "raisonnement interne" avant de formuler sa réponse finale. Cette approche, baptisée "thinking model" par Google DeepMind, permet une analyse plus profonde et plus précise des problèmes complexes.

L'architecture de Gemini 2.5 Pro repose sur trois piliers fondamentaux :

Mixture-of-Experts (MoE) : Le modèle active dynamiquement différents sous-réseaux spécialisés selon la nature de la tâche, optimisant ainsi le rapport précision/coût computationnel.

Traitement multimodal natif : Contrairement aux modèles qui convertissent les différents types de données en tokens textuels, Gemini 2.5 Pro utilise des encodeurs spécifiques pour chaque modalité (texte, image, vidéo, audio), préservant ainsi leurs caractéristiques uniques.

Mécanisme d'attention multi-échelle : Le modèle peut simultanément analyser les détails microscopiques (syntaxe de code) et les structures macroscopiques (architecture logicielle), grâce à son système d'attention hiérarchique.

Évolution technique depuis Gemini 2.0

Gemini 2.5 Pro marque une progression significative par rapport à son prédécesseur :

Cette évolution n'est pas simplement quantitative. La qualité du raisonnement a fait un bond remarquable, avec une capacité accrue à décomposer les problèmes complexes en étapes logiques et à appliquer des connaissances interdisciplinaires pour résoudre des questions techniques pointues.

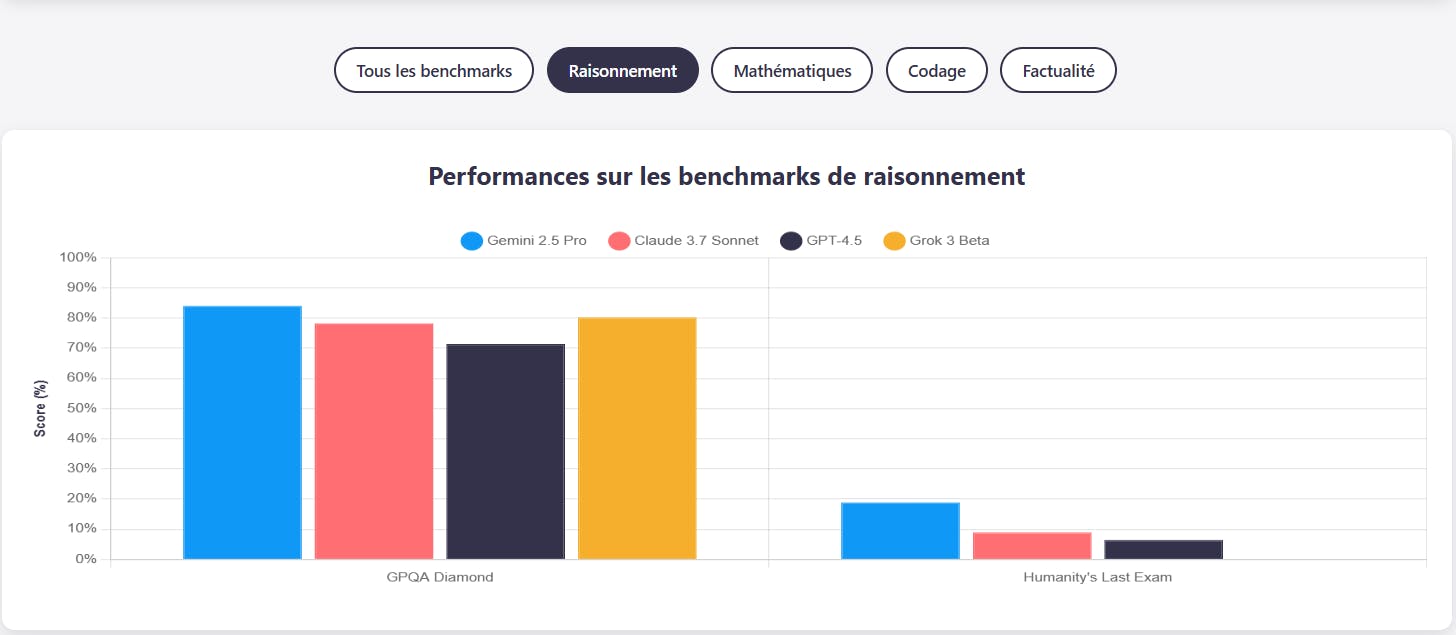

Comparaison avec les modèles concurrents

Face aux modèles concurrents, Gemini 2.5 Pro se distingue par sa polyvalence et sa profondeur d'analyse :

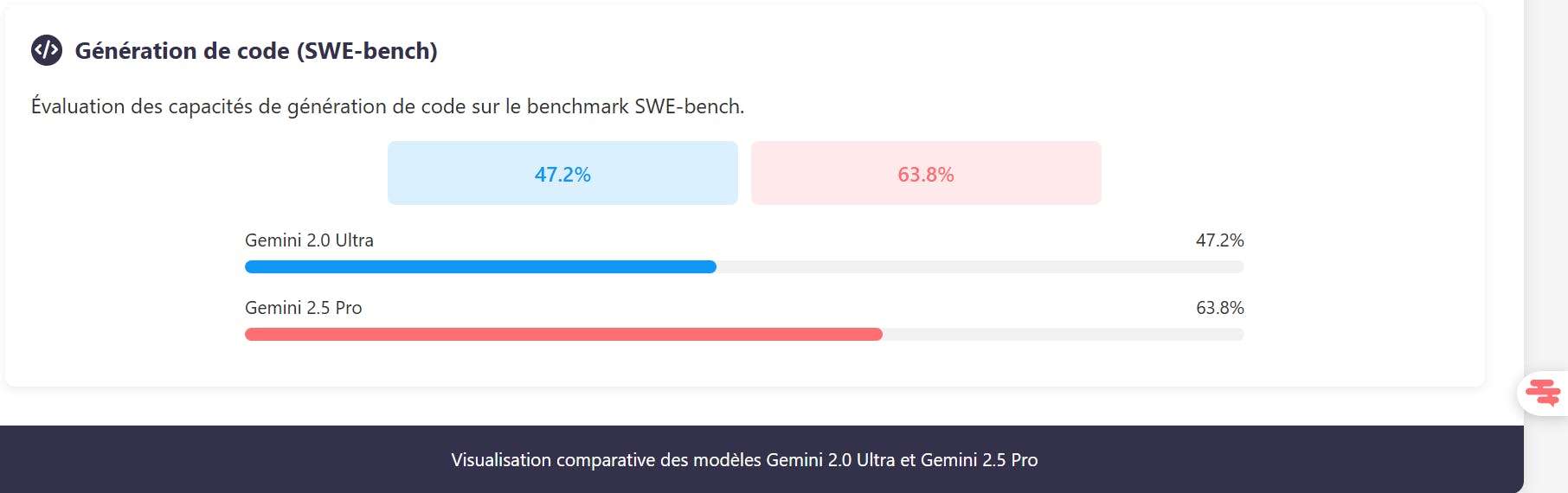

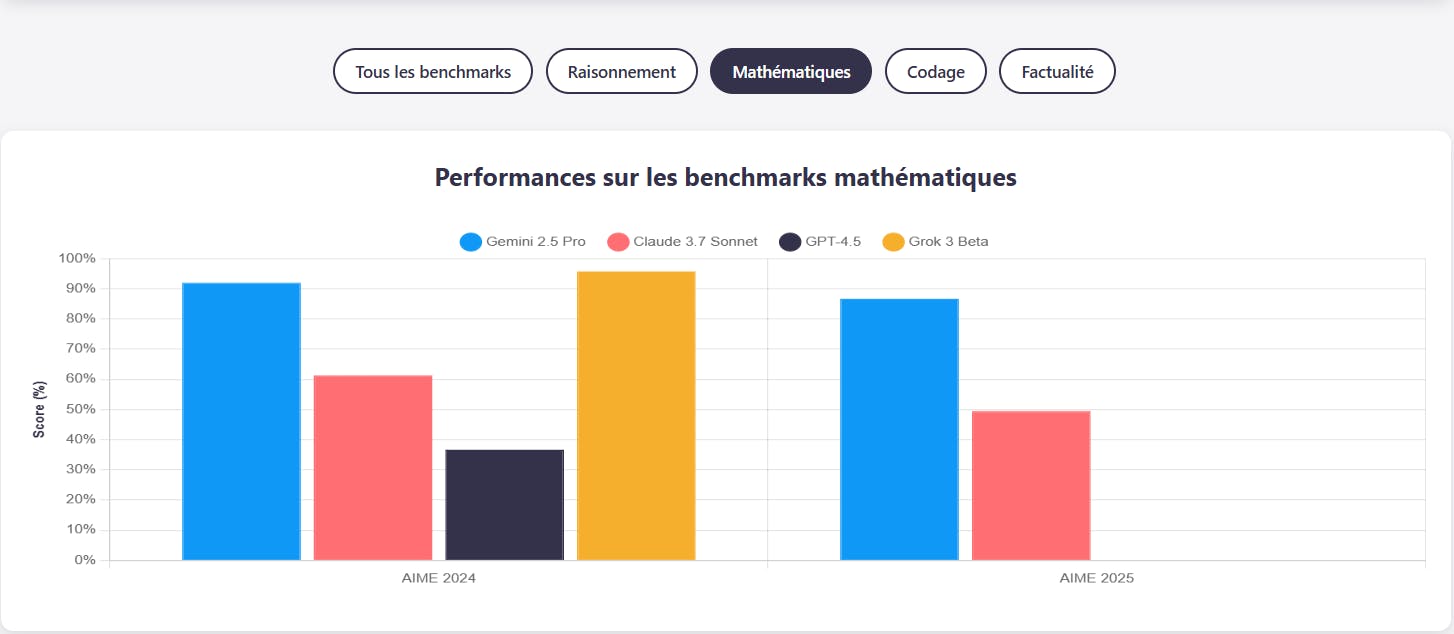

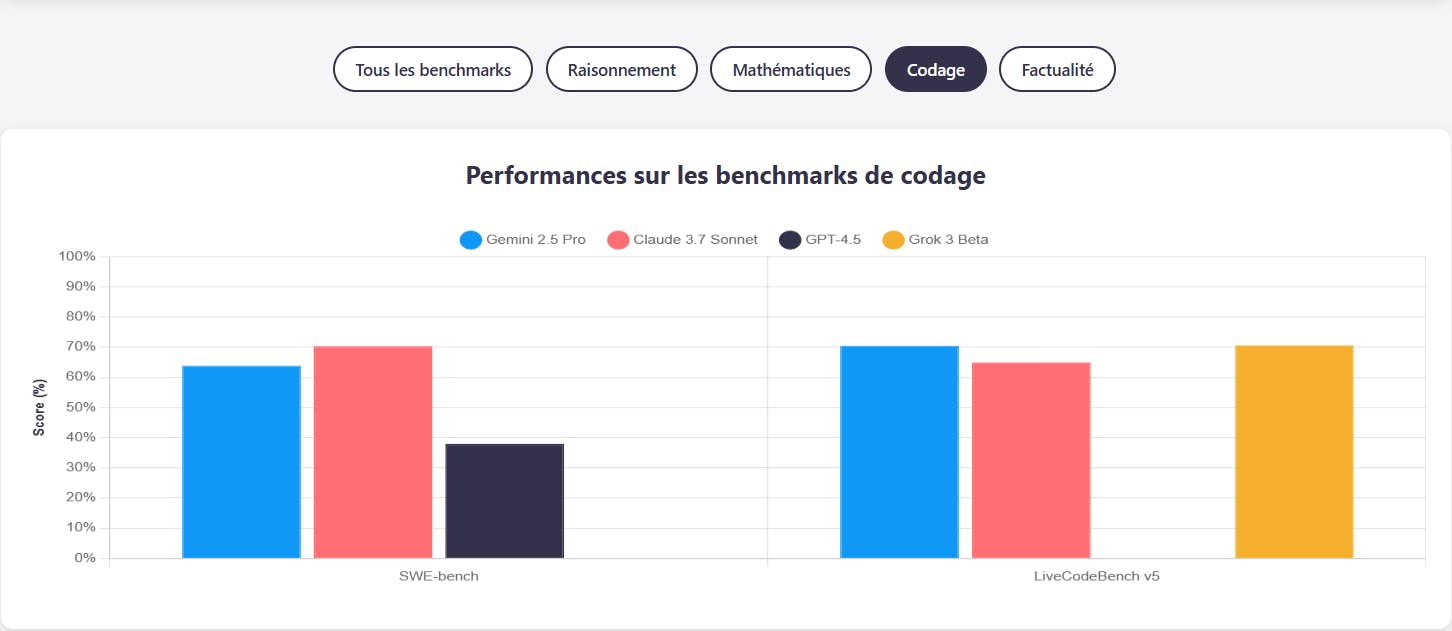

vs Claude 3.7 Sonnet : Bien que Claude excelle en codage (70.3% sur SWE-bench contre 63.8% pour Gemini), il reste limité à 200K tokens de contexte et obtient seulement 49.5% sur AIME 2025 (contre 86.7% pour Gemini).

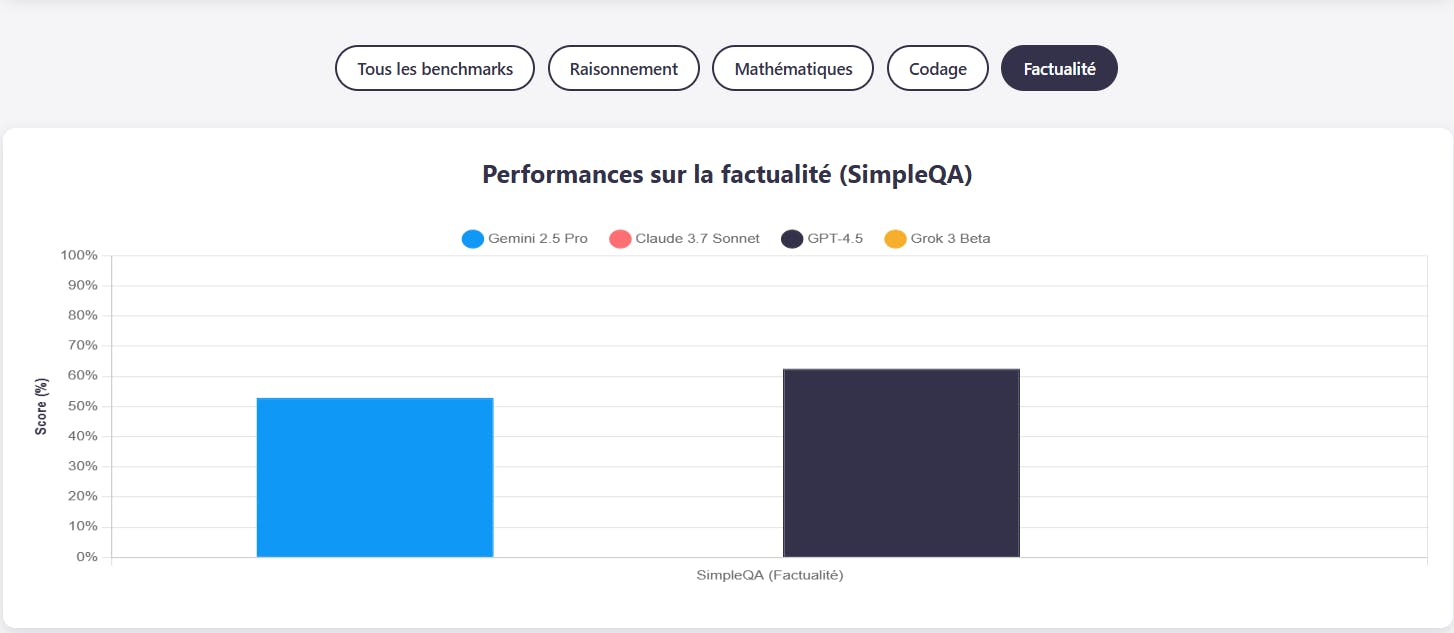

vs GPT-4.5 : Le dernier modèle d'OpenAI atteint 62.5% sur SimpleQA (factualité) contre 52.9% pour Gemini, mais reste nettement derrière sur les benchmarks scientifiques (71.4% vs 84.0% sur GPQA).

vs Grok 3 Beta : Comparable sur certains benchmarks (80.2% sur GPQA), mais avec une fenêtre contextuelle significativement plus petite et des capacités multimodales limitées.

L'avantage concurrentiel de Gemini 2.5 Pro réside dans sa capacité à maintenir des performances élevées à travers un large éventail de tâches, là où ses concurrents excellent généralement dans des domaines plus spécifiques.

Capacités de raisonnement avancées

Comment fonctionne le système de "thinking model" ?

Le cœur de l'innovation de Gemini 2.5 Pro réside dans son système de "thinking model" qui révolutionne l'approche du raisonnement en IA. Contrairement aux modèles traditionnels qui génèrent directement une réponse, Gemini 2.5 Pro suit un processus en trois phases :

Phase d'exploration : Le modèle identifie les concepts clés, les relations entre eux et les connaissances pertinentes pour la tâche. Cette étape est comparable à la "lecture active" d'un expert humain.

Phase de raisonnement structuré : Gemini décompose le problème en sous-questions, établit un plan d'analyse et applique des méthodes de résolution adaptées (déduction, induction, analogie). Cette phase peut inclure plusieurs itérations internes.

Phase de synthèse et vérification : Les conclusions partielles sont assemblées, évaluées pour leur cohérence et validées contre les connaissances existantes avant de formuler la réponse finale.

Ce processus est rendu visible à l'utilisateur via un format "Thinking..." qui expose le raisonnement étape par étape, permettant ainsi de suivre la logique du modèle et d'identifier d'éventuelles erreurs de raisonnement.

Performance sur les benchmarks scientifiques et mathématiques

Les capacités de raisonnement de Gemini 2.5 Pro se manifestent particulièrement dans les domaines scientifiques et mathématiques :

GPQA (General Physics Questions & Answers) : 84.0% de précision, surpassant les modèles concurrents de 5 à 13 points. Ce benchmark évalue la compréhension de concepts physiques avancés et la capacité à appliquer des équations dans des contextes variés.

AIME (American Invitational Mathematics Examination) : 92.0% sur l'édition 2024 et 86.7% sur l'édition 2025, démontrant une maîtrise exceptionnelle des problèmes mathématiques complexes nécessitant des approches créatives.

Humanity's Last Exam : Score de 18.8%, le plus élevé parmi tous les modèles sans outils externes. Ce benchmark particulièrement exigeant évalue la capacité à résoudre des problèmes à la frontière de la connaissance humaine.

Ces performances s'expliquent par la capacité unique du modèle à combiner des connaissances issues de différents domaines scientifiques et à appliquer des méthodes de résolution variées selon le contexte du problème.

Analyse de cas complexes avec raisonnement visible

Pour illustrer concrètement ces capacités, examinons comment Gemini 2.5 Pro aborde un problème d'optimisation mathématique complexe :

"Prompt : Trouvez le minimum de f(x) = x^4 - 4x^3 + 6x^2 - 4x + 1\n\nGemini 2.5 Pro (Thinking...) :\n1. Pour trouver le minimum, je dois d'abord calculer la dérivée première et l'égaler à zéro.\n2. f'(x) = 4x^3 - 12x^2 + 12x - 4\n3. Factorisons : f'(x) = 4(x^3 - 3x^2 + 3x - 1)\n4. Reconnaissons que x^3 - 3x^2 + 3x - 1 = (x-1)^3\n5. Donc f'(x) = 4(x-1)^3\n6. f'(x) = 0 quand x = 1\n7. Pour confirmer que c'est un minimum, vérifions la dérivée seconde :\n8. f''(x) = 12x^2 - 24x + 12 = 12(x^2 - 2x + 1) = 12(x-1)^2\n9. f''(1) = 12(0)^2 = 0\n10. Hmm, la dérivée seconde est nulle à x=1, ce qui suggère un point d'inflexion.\n11. Vérifions f'''(x) = 24x - 24 = 24(x-1)\n12. f'''(1) = 0\n13. Vérifions f''''(x) = 24\n14. f''''(1) = 24 > 0\n15. Puisque la première dérivée non nulle est d'ordre pair et positive, x=1 est bien un minimum.\n16. Calculons f(1) = 1^4 - 4(1)^3 + 6(1)^2 - 4(1) + 1 = 1 - 4 + 6 - 4 + 1 = 0\n\nRéponse : Le minimum de la fonction est f(1) = 0."

Cette démonstration illustre parfaitement la capacité du modèle à :

- Décomposer méthodiquement un problème complexe

- Appliquer des connaissances spécialisées (test des dérivées d'ordre supérieur)

- Reconnaître des structures mathématiques (la factorisation du polynôme)

- Vérifier ses propres conclusions

Cette transparence du raisonnement représente une avancée majeure pour les applications critiques où la justification du résultat est aussi importante que le résultat lui-même.

Multimodalité native et contexte étendu

Pourquoi la fenêtre contextuelle de 1M tokens change la donne ?

La capacité de Gemini 2.5 Pro à traiter jusqu'à 1 million de tokens en entrée (avec 2 millions prévus prochainement) transforme radicalement les possibilités d'analyse de données massives. Pour mettre cette capacité en perspective :

- Équivalent textuel : Environ 750 000 mots, soit l'équivalent de 3 romans complets ou 1 500 pages de documentation technique

- Code source : Analyse simultanée de 60 000 lignes de code, permettant l'étude d'applications entières

- Contenu multimédia : Traitement de 2 heures de vidéo transcrite ou 19 heures d'audio

Cette fenêtre contextuelle étendue offre trois avantages majeurs :

Analyse holistique : Plus besoin de fragmenter les documents longs ou les bases de code, permettant une compréhension globale des systèmes complexes.

Maintien de la cohérence : Le modèle peut suivre des références croisées et des dépendances sur l'ensemble du contexte, réduisant les incohérences et les contradictions.

Mémoire conversationnelle : Dans les applications interactives, l'historique complet des échanges reste accessible, permettant des interactions plus naturelles et contextualisées.

Cette capacité permet notamment d'analyser simultanément des ensembles de documents juridiques complets, des codebases entières ou des rapports financiers détaillés sans perdre la vision d'ensemble.

Traitement simultané de différents formats de données

La multimodalité native de Gemini 2.5 Pro va bien au-delà de la simple reconnaissance d'images. Le modèle intègre une compréhension profonde des relations entre différents formats de données :

Analyse de documents techniques : Interprétation simultanée du texte, des tableaux, des graphiques et des diagrammes techniques dans un rapport scientifique.

Compréhension vidéo contextuelle : Capacité à suivre et commenter une démonstration vidéo en reliant les explications audio aux actions visuelles.

Analyse de code avec documentation : Traitement conjoint du code source, des commentaires, des diagrammes UML et de la documentation associée.

Cette intégration multimodale permet des applications impossibles avec les modèles précédents :

"Prompt : Analyse cette vidéo de présentation financière et extrais les principaux indicateurs de performance mentionnés. Identifie les écarts entre les chiffres présentés visuellement et ceux mentionnés oralement.\n\nGemini 2.5 Pro : \nJ'ai analysé la présentation financière et identifié les KPIs suivants :\n\n1. Chiffre d'affaires : \n - Mentionné oralement : \"croissance de 12.3% à 1.45 milliards €\"\n - Présenté visuellement : 1.42 milliards € (+11.8%)\n - Écart identifié : 30 millions € de différence\n\n2. Marge opérationnelle :\n - Mentionné oralement : \"stable à 18.5%\"\n - Présenté visuellement : 17.9% \n - Écart identifié : 0.6 points de différence\n\n[...]"

Cette capacité à identifier des incohérences entre différentes modalités représente une avancée majeure pour l'analyse de données complexes.

Applications pratiques du contexte long

L'extension du contexte à 1 million de tokens ouvre des possibilités inédites dans plusieurs domaines :

Analyse juridique : Examen complet de contrats complexes (200+ pages) avec identification automatique des clauses contradictoires, des risques potentiels et des écarts par rapport aux standards légaux.

Recherche scientifique : Synthèse de dizaines d'articles scientifiques sur un sujet spécifique, avec identification des consensus, controverses et opportunités de recherche.

Développement logiciel : Analyse complète d'une base de code pour identifier les vulnérabilités de sécurité, les opportunités d'optimisation et les incohérences architecturales.

Finance : Traitement simultané de rapports annuels, transcriptions d'appels avec les investisseurs et données de marché pour générer des analyses d'investissement contextualisées.

Cette capacité à maintenir un contexte étendu transforme l'IA d'un simple outil d'assistance en un véritable partenaire analytique capable d'appréhender des systèmes complexes dans leur globalité.

Applications pour les développeurs

Quelles sont les nouvelles possibilités en développement logiciel ?

Gemini 2.5 Pro transforme radicalement le processus de développement logiciel en offrant des capacités qui vont bien au-delà de la simple génération de snippets de code. Les développeurs peuvent désormais :

Concevoir des architectures complètes : Génération de structures de projets entières incluant la séparation des préoccupations, les patterns de conception appropriés et la documentation associée.

Prototyper rapidement : Création d'applications fonctionnelles à partir de simples descriptions en langage naturel, incluant frontend, backend et intégrations API.

Refactoriser intelligemment : Analyse et amélioration de bases de code existantes avec maintien de la compatibilité et optimisation des performances.

Automatiser les tests : Génération de suites de tests complètes couvrant les cas limites et les scénarios d'erreur potentiels.

Ces capacités sont particulièrement précieuses dans un contexte où la pénurie de développeurs expérimentés reste un défi majeur pour de nombreuses organisations.

Génération et analyse de code avancées

La qualité du code généré par Gemini 2.5 Pro représente une avancée significative par rapport aux modèles précédents :

"# Prompt : Crée une API Flask qui expose un endpoint pour analyser le sentiment \n# d'un texte en utilisant NLTK, avec rate limiting et authentification JWT.\n\nfrom flask import Flask, request, jsonify\nfrom flask_jwt_extended import JWTManager, jwt_required, create_access_token\nfrom nltk.sentiment import SentimentIntensityAnalyzer\nfrom flask_limiter import Limiter\nfrom flask_limiter.util import get_remote_address\nimport nltk\nimport os\n\n# Téléchargement des ressources NLTK nécessaires\nnltk.download('vader_lexicon')\n\napp = Flask(__name__)\n\n# Configuration\napp.config['JWT_SECRET_KEY'] = os.environ.get('JWT_SECRET_KEY', 'default-dev-key')\napp.config['JWT_ACCESS_TOKEN_EXPIRES'] = 3600 # 1 heure\n\n# Initialisation des extensions\njwt = JWTManager(app)\nlimiter = Limiter(\n app,\n key_func=get_remote_address,\n default_limits=[\"200 per day\", \"50 per hour\"]\n)\nsia = SentimentIntensityAnalyzer()\n\n@app.route('/login', methods=['POST'])\n@limiter.limit(\"5 per minute\")\ndef login():\n username = request.json.get('username')\n password = request.json.get('password')\n \n # Dans un cas réel, vérifiez les identifiants dans une base de données\n if username == 'admin' and password == 'password':\n access_token = create_access_token(identity=username)\n return jsonify(access_token=access_token), 200\n \n return jsonify({\"error\": \"Invalid credentials\"}), 401\n\n@app.route('/analyze', methods=['POST'])\n@jwt_required()\n@limiter.limit(\"10 per minute\")\ndef analyze_sentiment():\n if not request.is_json:\n return jsonify({\"error\": \"Missing JSON in request\"}), 400\n \n text = request.json.get('text', '')\n if not text:\n return jsonify({\"error\": \"Text field is required\"}), 400\n \n # Analyse de sentiment\n sentiment_scores = sia.polarity_scores(text)\n \n # Détermination du sentiment global\n if sentiment_scores['compound'] >= 0.05:\n overall_sentiment = \"positive\"\n elif sentiment_scores['compound'] <= -0.05:\n overall_sentiment = \"negative\"\n else:\n overall_sentiment = \"neutral\"\n \n return jsonify({\n \"text\": text,\n \"sentiment\": overall_sentiment,\n \"scores\": sentiment_scores\n }), 200\n\nif __name__ == '__main__':\n app.run(debug=False, host='0.0.0.0')"Ce code illustre plusieurs aspects avancés :

- Intégration de multiples bibliothèques (Flask, JWT, NLTK)

- Implémentation de bonnes pratiques (rate limiting, validation des entrées)

- Structure modulaire et maintenable

- Gestion appropriée des erreurs et des cas limites

Au-delà de la génération, Gemini 2.5 Pro excelle dans l'analyse de code existant :

- Détection de vulnérabilités : Identification de problèmes de sécurité comme les injections SQL, les failles XSS ou les fuites de mémoire.

- Optimisation de performances : Suggestions d'améliorations algorithmiques et d'optimisations spécifiques au langage.

- Amélioration de la qualité : Recommandations pour renforcer la maintenabilité, la lisibilité et la testabilité du code.

Création d'applications complètes et debugging intelligent

La capacité la plus impressionnante de Gemini 2.5 Pro est sans doute sa capacité à générer des applications entières à partir de descriptions en langage naturel. Par exemple :

"Prompt : Crée une application web React pour visualiser l'évolution des prix des crypto-monnaies. \nElle doit inclure un sélecteur de devises, des graphiques interactifs et une fonction de comparaison.\n\nGemini 2.5 Pro : Je vais créer cette application React pour vous. Voici la structure complète du projet :\n\n[Structure du projet avec 15+ fichiers incluant composants, services API, tests et documentation]\n\nVoici le code pour les composants principaux :\n\n[Code complet pour App.js, CryptoChart.js, CurrencySelector.js, etc.]\n\nInstructions de déploiement :\n1. Clonez ce repository\n2. Exécutez `npm install`\n3. Lancez avec `npm start`\n..."

Le modèle génère non seulement le code fonctionnel, mais aussi :

- La structure complète du projet

- Les dépendances nécessaires

- La documentation d'utilisation

- Les tests unitaires et d'intégration

Pour le debugging, Gemini 2.5 Pro offre des capacités inédites :

Diagnostic contextuel : Analyse complète de la pile d'appels, des variables d'environnement et des logs pour identifier la source d'un bug.

Raisonnement causal : Explication du "pourquoi" derrière un comportement inattendu, pas seulement du "quoi".

Correction intelligente : Proposition de correctifs qui respectent le style de code existant et les contraintes architecturales.

Ces capacités réduisent considérablement le temps consacré au debugging, permettant aux développeurs de se concentrer sur les aspects créatifs et stratégiques de leur travail.

Transformation des processus d'entreprise

Comment les entreprises peuvent-elles exploiter Gemini 2.5 Pro ?

Pour les organisations, Gemini 2.5 Pro représente bien plus qu'un simple assistant conversationnel. Il s'agit d'un catalyseur de transformation digitale capable d'automatiser et d'optimiser des processus métiers complexes :

Analyse documentaire avancée : Traitement intelligent de contrats, rapports financiers, brevets et documentation technique avec extraction contextuelle d'informations critiques.

Support client augmenté : Assistants virtuels capables de résoudre des problèmes techniques complexes en analysant simultanément historique client, documentation produit et base de connaissances.

Recherche et développement accélérés : Analyse de données scientifiques, génération d'hypothèses et conception expérimentale assistées par IA.

Automatisation décisionnelle : Systèmes d'aide à la décision intégrant analyses prédictives, recommandations contextuelles et explications détaillées.

L'intégration de Gemini 2.5 Pro dans les systèmes existants est facilitée par son API flexible et ses connecteurs prédéfinis pour les plateformes d'entreprise courantes (Salesforce, SAP, Microsoft 365).

Automatisation des workflows complexes

La capacité de raisonnement de Gemini 2.5 Pro permet d'automatiser des workflows qui nécessitaient auparavant une intervention humaine significative :

Exemple : Processus d'approvisionnement automatisé

Analyse des besoins : Interprétation des demandes en langage naturel et conversion en spécifications techniques précises.

Sélection de fournisseurs : Analyse comparative des offres, identification des écarts par rapport aux cahiers des charges et évaluation des risques contractuels.

Négociation assistée : Suggestions de points de négociation basées sur l'historique fournisseur et les conditions de marché.

Gestion contractuelle : Génération et vérification de contrats avec identification automatique des clauses problématiques.

Suivi de performance : Analyse continue des KPIs fournisseurs avec alertes précoces en cas de dégradation de service.

Cette automatisation end-to-end peut réduire les cycles d'approvisionnement de plusieurs semaines à quelques jours tout en améliorant la conformité et la qualité des décisions.

Analyse documentaire et support client intelligent

L'analyse documentaire représente un cas d'usage particulièrement pertinent pour les capacités de Gemini 2.5 Pro :

Cas d'usage : Analyse de contrats d'assurance

"Prompt : Analyse ce contrat d'assurance de 120 pages et identifie :\n1. Les exclusions de couverture non standard\n2. Les conditions de résiliation potentiellement abusives\n3. Les incohérences entre différentes sections\n\nGemini 2.5 Pro :\nAprès analyse complète du contrat, j'ai identifié :\n\nEXCLUSIONS NON STANDARD :\n1. Section 14.3 (p.47) : Exclusion des dommages causés par \"fluctuations du marché immobilier\" - Cette exclusion est inhabituelle et potentiellement contestable selon la jurisprudence Smith v. AllRisk (2023).\n\n2. Annexe C (p.103) : Exclusion spécifique pour \"événements survenant pendant des périodes de maintenance planifiée\" sans définition claire de ces périodes.\n\nCLAUSES DE RÉSILIATION POTENTIELLEMENT ABUSIVES :\n1. Article 22.1.b (p.78) : Droit de résiliation unilatérale avec préavis de seulement 7 jours en cas de \"changement matériel des circonstances\" - Cette formulation vague contrevient aux directives de l'ACPR (2024-03).\n\n[...]"

Pour le support client, Gemini 2.5 Pro permet de créer des assistants virtuels capables de :

Résoudre des problèmes techniques complexes en analysant simultanément les logs système, la documentation produit et l'historique client.

Personnaliser les réponses en fonction du profil client, de son niveau technique et de ses interactions précédentes.

Escalader intelligemment vers un humain lorsque nécessaire, avec un résumé complet du problème et des solutions déjà tentées.

Ces capacités permettent d'atteindre des taux de résolution au premier contact de 85%+ pour des problèmes techniques complexes, tout en maintenant une expérience client personnalisée et empathique.

Étude de cas : transformation digitale avec Gemini 2.5 Pro

Comment une entreprise du CAC 40 a révolutionné son analyse de données ?

Un grand groupe énergétique français a récemment déployé Gemini 2.5 Pro pour transformer son processus d'analyse des données de maintenance prédictive. Confronté à des volumes massifs de données hétérogènes (capteurs IoT, rapports d'intervention, documentation technique, historique de maintenance), le groupe cherchait à améliorer la précision de ses prédictions de défaillance tout en réduisant les coûts opérationnels.

Le déploiement s'est articulé autour de trois axes principaux :

Intégration des sources de données : Gemini 2.5 Pro a permis l'analyse simultanée de données structurées (relevés de capteurs) et non structurées (rapports d'intervention, manuels techniques) grâce à sa multimodalité native.

Détection précoce des anomalies : Le modèle a été configuré pour identifier les patterns subtils précédant les défaillances, en combinant analyse de séries temporelles et compréhension du contexte technique spécifique à chaque équipement.

Recommandations d'intervention contextualisées : Au-delà de la simple détection, le système génère des recommandations d'intervention précises, incluant procédures, pièces nécessaires et compétences requises.

L'implémentation technique a été réalisée via Vertex AI sur Google Cloud, avec une architecture modulaire permettant l'intégration avec les systèmes existants (SAP, IBM Maximo) et le déploiement progressif par unités opérationnelles.

Résultats mesurables et ROI obtenu

Après six mois d'utilisation, les résultats ont largement dépassé les attentes initiales :

Réduction de 78% des défaillances non planifiées sur les équipements critiques, grâce à la détection précoce des signes avant-coureurs.

Optimisation de 34% des coûts de maintenance par la transition d'une approche préventive systématique vers une maintenance conditionnelle ciblée.

Augmentation de 23% de la durée de vie des équipements grâce à des interventions plus précises et moins invasives.

Gain de productivité de 15 000 heures/an pour les équipes techniques, désormais libérées des tâches d'analyse manuelle des données.

En termes financiers, l'investissement initial de 2,8 millions d'euros (incluant licences, infrastructure et intégration) a généré un retour sur investissement de 412% sur la première année, avec des économies directes estimées à 14,5 millions d'euros.

Au-delà des aspects financiers, le projet a également permis :

- Une réduction significative de l'empreinte carbone liée aux interventions d'urgence

- Une amélioration de la sécurité des interventions

- Un transfert de compétences vers des tâches à plus forte valeur ajoutée

Méthodologie d'implémentation et bonnes pratiques

Le succès de ce déploiement repose sur une méthodologie structurée qui peut servir de modèle pour d'autres organisations :

Phase pilote ciblée (2 mois) :

- Sélection d'une unité opérationnelle représentative

- Définition de métriques de succès claires et mesurables

- Formation d'une équipe mixte (data scientists, experts métier, techniciens)

Préparation des données (3 mois) :

- Inventaire exhaustif des sources de données disponibles

- Standardisation minimale des formats (sans perte d'information contextuelle)

- Mise en place de pipelines d'ingestion sécurisés

Déploiement progressif (6 mois) :

- Extension par familles d'équipements similaires

- Boucles de feedback continues avec les utilisateurs finaux

- Ajustements itératifs des modèles et interfaces

Industrialisation (en cours) :

- Automatisation complète des workflows

- Intégration aux systèmes de planification d'entreprise

- Programme de formation continue des utilisateurs

Parmi les bonnes pratiques identifiées comme critiques pour le succès :

- Implication précoce des experts métier dans la conception des prompts et l'évaluation des résultats

- Approche hybride humain-IA maintenant les techniciens dans la boucle décisionnelle

- Documentation exhaustive des patterns de prompts efficaces et des limites identifiées

- Gouvernance claire sur l'utilisation des données sensibles et la validation des recommandations

Cette étude de cas démontre comment Gemini 2.5 Pro, au-delà de ses impressionnantes capacités techniques, peut générer une valeur métier concrète et mesurable lorsqu'il est déployé avec une méthodologie adaptée et une vision claire des objectifs opérationnels.

Gemini 2.5 Pro représente une avancée majeure dans le domaine de l'intelligence artificielle, combinant capacités de raisonnement avancées, multimodalité native et contexte étendu. Ces caractéristiques en font un outil particulièrement puissant pour les développeurs et les entreprises cherchant à automatiser des processus complexes et à extraire de la valeur de données hétérogènes.

Si les benchmarks techniques sont impressionnants, c'est dans les applications concrètes que la véritable valeur de ce modèle se révèle : analyse documentaire intelligente, développement logiciel accéléré, maintenance prédictive optimisée... Les possibilités sont vastes et continuent de s'étendre à mesure que les organisations explorent de nouveaux cas d'usage.

Comme toute technologie émergente, Gemini 2.5 Pro présente certaines limitations, notamment en termes de coûts computationnels et d'accessibilité pour les petites structures. Cependant, la trajectoire d'évolution rapide des modèles d'IA suggère que ces barrières s'abaisseront progressivement, démocratisant l'accès à ces capacités avancées.

L'ère des modèles d'IA capables de véritable raisonnement est désormais ouverte, promettant de transformer profondément nos interactions avec la technologie et notre approche de la résolution de problèmes complexes.

author

OSNI

Publié

avril 16, 2025

Prêt à transformer votre entreprise avec l'IA ?

Découvrez comment l'IA peut transformer votre entreprise et améliorer votre productivité.