Table des matières :

Gouvernance des agents IA : le guide pour les entreprises

Déployer des agents IA dans une organisation, c'est simple. Les piloter, les sécuriser et en garder le contrôle quand ils se multiplient — c'est une autre affaire. La gouvernance des agents IA est devenue l'enjeu central de toute stratégie d'adoption à l'échelle.

Prêt à transformer votre entreprise avec l'IA ?

Découvrez comment l'IA peut transformer votre entreprise et améliorer votre productivité.

Sans cadre structuré, chaque agent déployé est un risque potentiel : données exposées, coûts incontrôlés, responsabilités floues. Ce guide de gouvernance de l’ia agentique détaille les composantes essentielles d’une gouvernance efficace et les pratiques que les équipes IT et opérationnelles doivent mettre en place dès aujourd’hui.

Gouvernance des agents IA : de quoi parle-t-on exactement ?

La gouvernance des agents IA désigne l'ensemble des règles, processus et outils permettant à une organisation de contrôler qui déploie des agents IA, à quelles données ils accèdent, quelles actions ils peuvent exécuter, et comment leurs comportements sont tracés et audités.

Elle ne se réduit pas à la sécurité informatique. Elle englobe aussi la conformité réglementaire (RGPD, AI Act), la gestion des coûts, la traçabilité des décisions et l'attribution des responsabilités entre les équipes métier et IT.

Pourquoi ce sujet monte en priorité

Les agents IA ne sont plus des outils isolés. Ils s'interconnectent, accèdent à des bases de données, envoient des emails, déclenchent des workflows et agissent pour le compte de l'entreprise. Un agent mal configuré peut exposer des données clients, générer des coûts non prévus ou prendre des décisions contraires aux politiques internes.

Selon les retours terrain d'organisations ayant déployé des agents IA à grande échelle, les trois problèmes les plus fréquents sont :

- L'absence de visibilité sur qui utilise quel agent et à quel coût

- Le manque de contrôle sur les données auxquelles les agents accèdent

- L'impossibilité d'auditer les actions exécutées par les agents

C'est précisément pour répondre à ces enjeux que Swiftask a construit une console de gouvernance centralisée, pensée pour les équipes en entreprise.

À retenir : La gouvernance des agents IA couvre quatre dimensions : accès, actions, coûts et conformité. Négliger l'une d'elles expose l'organisation à des risques opérationnels et réglementaires.

Les 5 piliers d'une gouvernance efficace des agents IA

Une gouvernance solide repose sur cinq composantes interdépendantes. Voici comment les aborder concrètement.

1. Contrôle des accès et gestion des permissions

Chaque agent IA doit opérer dans un périmètre défini. Cela signifie préciser les droits via une gouvernance des identités pour les agents ia :

- Quels utilisateurs ou rôles peuvent créer, modifier ou désactiver un agent

- Quelles bases de données, APIs ou outils l'agent peut interroger

- Quels types d'actions l'agent est autorisé à exécuter (lecture seule, écriture, déclenchement d'automatisations)

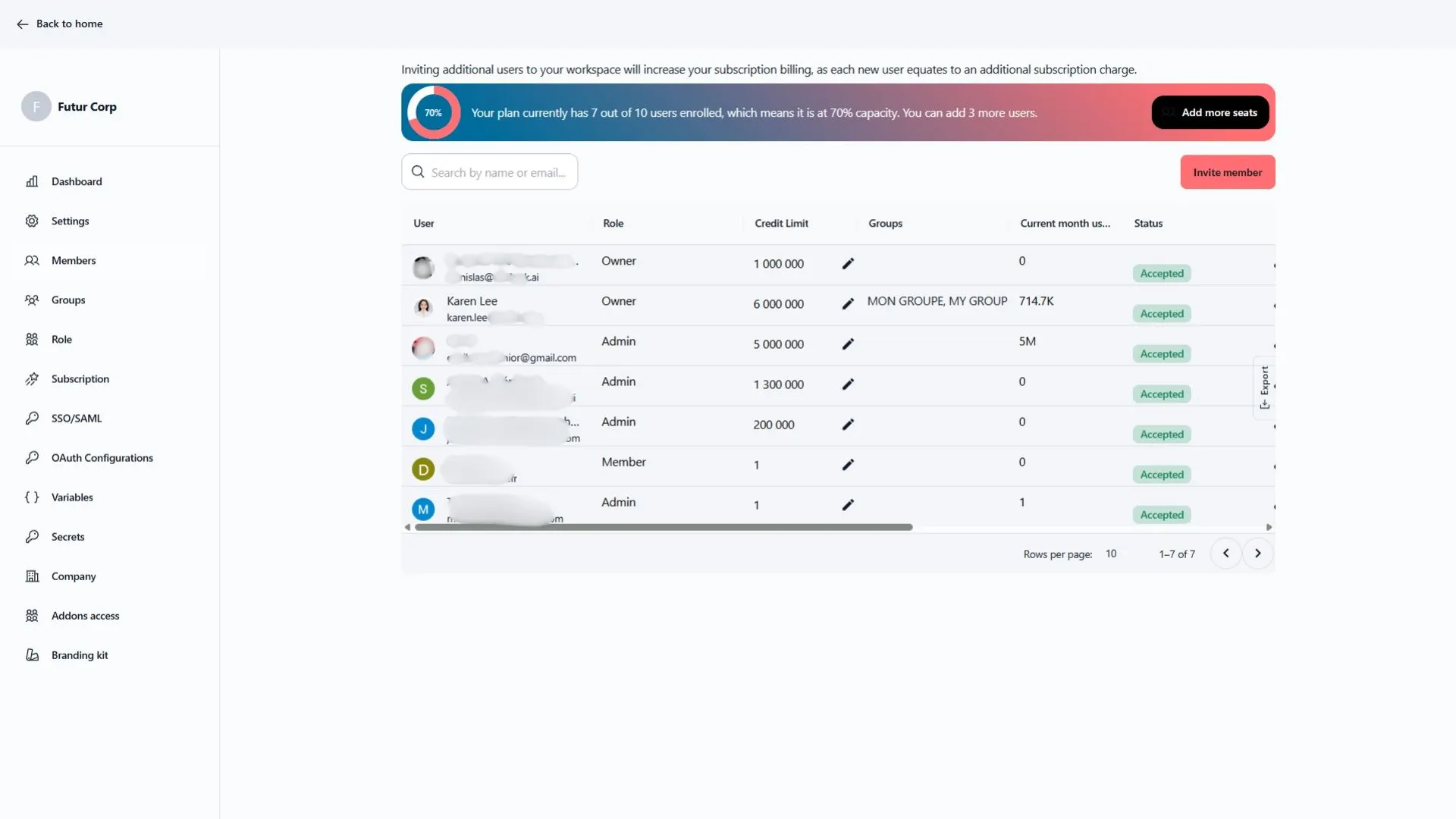

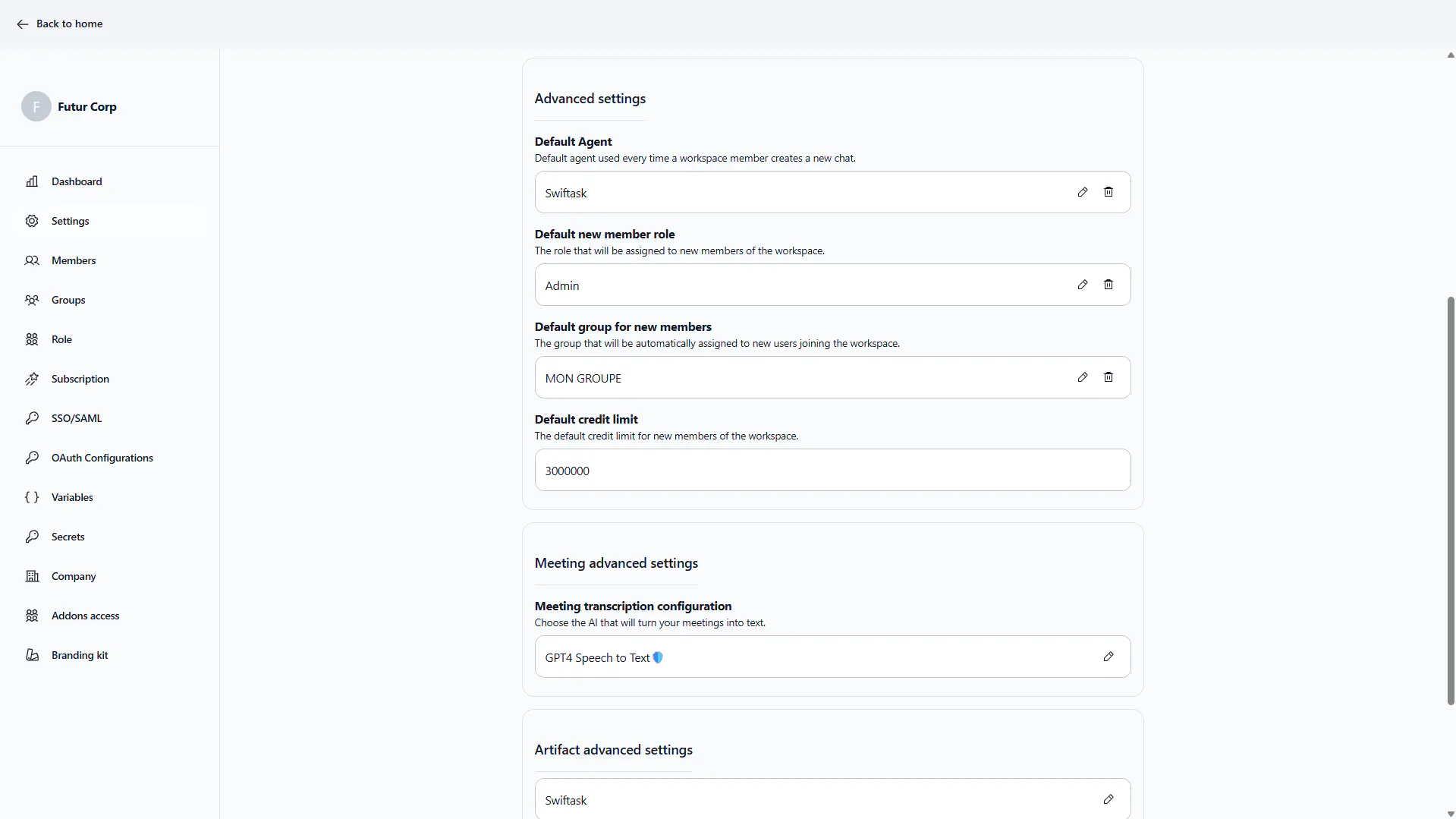

Un modèle de permissions granulaires — similaire à la gestion des droits dans un système IAM (Identity and Access Management) — est la norme dans les environnements enterprise. Sur Swiftask, chaque agent dispose d'un profil de droits configurable depuis la console d'administration, sans nécessiter de compétences techniques avancées.

2. Traçabilité et audit des actions

Un agent IA agit. Il faut pouvoir retracer chaque action : quelle requête a été formulée, quelle donnée a été consultée, quel résultat a été produit, et à quelle heure. Cette traçabilité sert trois objectifs :

- Détecter les comportements anormaux ou non conformes

- Répondre aux exigences d'audit réglementaire (RGPD, AI Act)

- Identifier les agents sous-performants ou mal configurés

Sans journal d'activité structuré, il est impossible de démontrer la conformité d'un déploiement IA à un régulateur ou à un comité d'audit interne.

3. Conformité RGPD et AI Act

Les agents IA traitent souvent des données à caractère personnel : emails, contrats, données clients, enregistrements de réunions. Le RGPD impose des obligations claires sur le traitement de ces données — base légale, minimisation, durée de conservation, droits des personnes concernées.

L'AI Act européen, entré progressivement en vigueur depuis 2024, ajoute une couche de classification des systèmes IA selon leur niveau de risque. Les agents IA utilisés en contexte professionnel peuvent relever de la catégorie "risque limité" ou "risque élevé" selon leurs fonctions.

Ce que cela implique concrètement :

- Documenter les traitements effectués par chaque agent

- S'assurer que les données sensibles ne sont pas exposées à des modèles tiers sans accord contractuel

- Choisir des infrastructures d'hébergement conformes (hébergement en Europe, certifications ISO 27001, SOC 2)

Swiftask est hébergé en France, conforme au RGPD, et propose des embedders souverains pour les organisations qui souhaitent limiter l'exposition de leurs données à des modèles américains.

4. Contrôle des coûts et pilotage budgétaire

Chaque appel à un LLM a un coût. Quand des dizaines d’agents tournent en parallèle, les dépenses peuvent s’emballer. Un pilotage des agents ia efficace inclut des plafonds de consommation par agent, par équipe ou par département, un tableau de bord en temps réel et des alertes automatiques :

- Des plafonds de consommation par agent, par équipe ou par département

- Un tableau de bord de suivi des coûts en temps réel

- Des alertes automatiques en cas de dépassement de seuil

C'est l'un des points de douleur les plus fréquents chez les DSI qui ont déployé des outils IA sans cadre centralisé : les factures arrivent sans qu'il soit possible d'en identifier l'origine précise.

5. Responsabilisation et attribution des rôles

Qui est responsable d'un agent IA qui commet une erreur ? Cette question, apparemment simple, est souvent sans réponse dans les organisations qui n'ont pas défini de cadre de gouvernance. Il faut désigner :

- Un owner par agent (responsable de sa configuration et de son comportement)

- Un administrateur de la plateforme (gestion des droits globaux)

- Des utilisateurs avec des niveaux d'accès différenciés

Ce modèle de rôles s'inspire directement des bonnes pratiques de gestion des systèmes d'information. Il s'applique naturellement à une plateforme d'agents IA no-code comme Swiftask, où chaque workspace dispose d'une console d'administration avec gestion des rôles, des groupes et des secrets.

Gouvernance des agents IA et IA agentique : ce qui change

L’IA agentique introduit une rupture par rapport aux usages précédents de l’IA en entreprise. La gouvernance de l’ia agentique exige des règles définies avant le déploiement, car l’autonomie des agents rend le contrôle plus complexe et plus critique. Un chatbot répond à des questions. Un agent IA, lui, prend des initiatives, enchaîne des tâches, appelle des APIs, délègue à d'autres agents.

Cette autonomie est précisément ce qui rend la gouvernance plus complexe — et plus critique.

Pourquoi l'autonomie des agents complique la gouvernance

Un modèle de langage classique (LLM) utilisé en mode conversationnel est passif : il répond quand on lui parle. Un agent IA peut, lui, agir sans sollicitation directe, en réponse à un déclencheur (email reçu, nouvelle entrée dans une base de données, heure programmée).

Cette capacité d'action autonome implique que les règles de gouvernance doivent être définies **avant** le déploiement, pas après. Une fois qu'un agent tourne en production, ses actions peuvent avoir des effets réels sur les systèmes de l'entreprise.

Multi-agents : quand les agents travaillent ensemble

Les architectures multi-agents amplifient les enjeux de gouvernance d’un écosystème d’agents ia. Chaque agent de la chaîne peut potentiellement accéder à des données ou exécuter des actions qui dépassent ce qui était initialement prévu.

Une bonne gouvernance multi-agents repose sur :

- Des périmètres d'action clairement définis pour chaque agent de la chaîne

- Une traçabilité de bout en bout des actions de la chaîne

- Un mécanisme d'interruption (kill switch) permettant de stopper l'ensemble de la chaîne en cas d'anomalie

Swiftask permet de construire des chaînes d'agents avec des règles de délégation explicites, et de visualiser les interactions entre agents depuis la console d'administration.

En résumé : L'IA agentique exige une gouvernance proactive. Définir les règles après le déploiement, c'est gouverner dans l'urgence. Les organisations les plus avancées intègrent la gouvernance dès la conception de chaque agent.

Comment mettre en place une gouvernance des agents IA : étapes pratiques

Voici un cadre en 5 étapes pour structurer la gouvernance de vos agents IA, applicable quelle que soit la taille de votre organisation.

Étape 1 — Cartographier vos agents existants : Avant de gouverner, il faut savoir ce qui existe. Listez tous les agents IA déployés, leur fonction, les données auxquelles ils accèdent et les équipes qui les utilisent. Cette cartographie révèle souvent des agents "fantômes" déployés sans validation IT.

Étape 2 — Définir une politique d'usage : Formalisez les règles : quels types d'agents sont autorisés, quelles données peuvent être utilisées, quels LLM sont approuvés. Cette politique doit être validée par la DSI, le DPO et les directions métier concernées.

Étape 3 — Configurer les permissions et les rôles : Déployez un modèle de droits granulaires sur votre plateforme d'agents IA. Chaque agent doit avoir un owner identifié, et chaque utilisateur doit disposer uniquement des accès nécessaires à son rôle.

Étape 4 — Activer la traçabilité et les alertes : Configurez les journaux d'activité et les alertes automatiques. Définissez des seuils de coût et des indicateurs de comportement anormal. Planifiez des audits réguliers.

Étape 5 — Documenter et former : La gouvernance n'est pas qu'une affaire technique. Les équipes qui utilisent des agents IA doivent comprendre les règles en vigueur. Une documentation claire et une formation initiale réduisent les risques d'usage non conforme.

Quelle est la différence entre gouvernance IA et sécurité IA ?

La sécurité IA se concentre sur la protection des systèmes contre les menaces externes (attaques, fuites de données, injections de prompts). La gouvernance IA est plus large : elle couvre aussi la conformité réglementaire, la gestion des droits internes, le contrôle des coûts et l'attribution des responsabilités. Les deux sont complémentaires et doivent être adressées conjointement.

L'AI Act s'applique-t-il à mes agents IA internes ?

L'AI Act européen s'applique aux systèmes IA mis sur le marché ou mis en service dans l'Union européenne. Les agents IA utilisés en interne par une entreprise européenne sont concernés dès lors qu'ils entrent dans les catégories de risque définies par le règlement. Les agents qui prennent des décisions ayant un impact sur des personnes (recrutement, scoring, surveillance) relèvent généralement de la catégorie "risque élevé" et sont soumis à des obligations renforcées.

Comment éviter le vendor lock-in avec les LLM de mes agents ?

Le risque de dépendance à un fournisseur de LLM est réel. Si tous vos agents reposent sur un seul modèle (ChatGPT, Claude, Gemini), un changement de tarification ou de politique d'usage de ce fournisseur peut paralyser vos workflows. La solution est d'opter pour une plateforme multi-LLM agnostique, permettant de changer de modèle sans reconfigurer l'ensemble de vos agents. C'est l'un des principes fondateurs de Swiftask : chaque agent peut utiliser le LLM le plus adapté à sa tâche, sans créer de dépendance à un fournisseur unique.

Comment mesurer le ROI d'une gouvernance des agents IA ?

Le ROI de la gouvernance se mesure sur plusieurs axes : réduction des incidents de sécurité, économies réalisées grâce au contrôle des coûts LLM, temps gagné sur les audits de conformité, et réduction des risques réglementaires. Une organisation qui déploie 50 agents sans gouvernance peut voir ses coûts LLM tripler en quelques semaines sans s'en apercevoir. Avec un pilotage centralisé, ces dérives sont détectées et corrigées en temps réel.

Ce que Swiftask apporte à la gouvernance de vos agents IA

Swiftask a été conçu dès l'origine pour les équipes en entreprise qui ont besoin de déployer des agents IA à grande échelle sans sacrifier le contrôle. La gouvernance n'est pas une fonctionnalité ajoutée après coup — c'est un pilier de l'architecture de la plateforme.

Ce que la console d'administration Swiftask permet :

Cas concret : Une DSI ayant déployé Swiftask sur 200 collaborateurs utilise la gouvernance centralisée pour contrôler les coûts tout en laissant aux équipes l'autonomie de créer leurs propres agents. Les accès sont définis par département, et chaque agent est associé à un owner identifié.

En résumé : Swiftask combine la flexibilité d'une plateforme no-code avec le niveau de contrôle attendu par les DSI et les directions conformité. C'est la combinaison qui manquait entre l'agilité des équipes métier et les exigences de gouvernance de l'IT.

Passer de l'adoption à la maîtrise : le prochain cap pour les entreprises qui déploient des agents IA

Déployer des agents IA est devenu accessible. Les gouverner avec rigueur, c'est ce qui distingue les organisations qui tirent durablement de la valeur de l'IA de celles qui accumulent des risques sans le savoir.

La gouvernance des agents IA n'est pas un frein à l'innovation. C'est ce qui permet de déployer plus vite, plus loin et en toute confiance — parce que chaque agent opère dans un cadre défini, traçable et auditable.

author

OSNI

Publié

mars 20, 2026

Prêt à transformer votre entreprise avec l'IA ?

Découvrez comment l'IA peut transformer votre entreprise et améliorer votre productivité.